Arm shares slide on smartphone market weakness, AI chip supply concerns

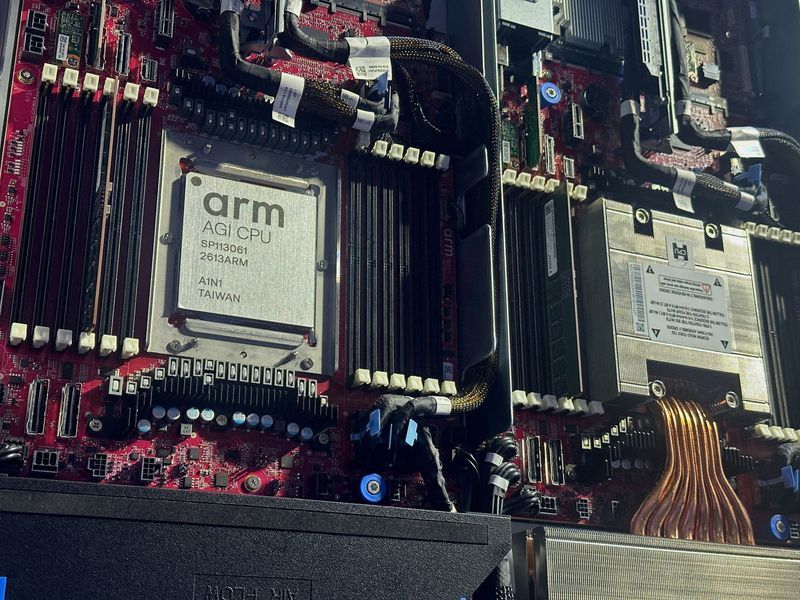

May 7 (Reuters) - Arm shares tumbled on Thursday after the company warned of smartphone market softness and challenges in securing supply for its new artificial intelligence chip...